Quando gli stereotipi e i pregiudizi intaccano anche l'AI: sarà mai possibile la piena inclusività?

Sono ormai numerosissimi gli studi che evidenziano una correlazione tra fruizione dei social media e fragilità psicologiche, che vanno dall’insoddisfazione di sé all’abbassamento dell’autostima, fino all’insorgenza di disturbi del comportamento alimentare. Ciò che è ancora poco indagato, però, sono gli effetti sulla salute mentale dell’utenza che utilizza frequentemente piattaforme che integrano l’AI. Come i social media, infatti, anche quest’ultime forniscono una rappresentazione della realtà imparziale e a tratti incompleta, perché istruite su tutto ciò che si può trovare in rete: database amplissimi, composti da analisi oggettive, studi, ma anche opinioni, commenti e pensieri espressi dai singoli individui e quindi del tutto arbitrari. Ciò che ne deriva è che, quando le piattaforme di AI si ritrovano a dover rispondere a delle domande, non è raro che manifestino, attraverso immagini, video e parole, bias inerenti al genere, all’etnia, alla classe sociale, al peso corporeo e alla sessualità. Una reiterazione di quegli stereotipi di cui i social media sono già ampiamente intrisi.

Per capire meglio ciò che questo fenomeno può arrecare alla salute psicologica di chi si interfaccia di frequente con tali strumenti, sarebbe utile ricordare cosa emerge dalla letteratura finora disponibile che ha scandagliato la relazione tra accesso al web e benessere mentale. Da almeno un decennio, infatti, è stata dimostrata una diretta correlazione tra l’esposizione sui social media e la bassa considerazione che le persone hanno di sé e del proprio corpo. Le donne, in particolare, vivono un confronto perenne tra loro stesse e l’ostentata perfezione proposta dai social, il che le può portare ad assumere atteggiamenti ossessivi che riguardano il loro aspetto. Lo studio del 2022 The association between social media addiction and eating disturbances is mediated by muscle dysmorphia-related symptoms: a cross-sectional study in a sample of young adults consultabile su Springer Nature ha dimostrato che il rapportarsi con ideali, a volte irraggiungibili, di magrezza e tonicità (ai quali sono stati i nomi di thinspiration e di fitspiration) può favorire un approccio disfunzionale all’esercizio fisico e al cibo e può rappresentare un fattore scatenante per i disturbi del comportamento alimentare (DCA).

I corpi idealizzati, però, non sono solo quelli femminili. Chi si riconosce nel genere maschile è, secondo gli studiosi, più incline a soffrire per la mancanza di massa muscolare. Come analizza lo studio del 2025 Associations between muscularity-oriented social media content and muscle dysmorphia among boys and men edito su Body Image, la dismorfia muscolare, come viene definita, è una condizione di salute mentale caratterizzata da una muscolatura percepita come insufficiente e può sfociare anche nell’assunzione, non sempre supervisionata da personale medico, di integratori e anabolizzanti. Un ruolo centrale è, ancora una volta, quello giocato dagli standard estetici promossi dalla società e riscontrabili sulla maggior parte dei media, che esaltano corpi maschili possenti, atletici e muscolosi.

Questi canoni di bellezza sono gli stessi che nutrono il sapere delle intelligenze artificiali. Nel calderone dei dati da cui attinge il team di progettazione di software ci sono anche i pregiudizi che negli anni hanno plasmato i parametri estetici, etici e comportamentali che chiunque, a seconda del genere in cui si riconosce, dovrebbe incarnare. Per quanto sia un fenomeno recentissimo, alcuni studi, come Artificial Intelligence, Bias, and Ethics, un’analisi del 2023 pubblicata su Proceedings of the Thirty-Second International Joint Conference on Artificial Intelligence, hanno dimostrato che l’AI generativa evidenzia, ad esempio, la frequente stereotipizzazione delle figure femminili, iper sessualizzate e troppo spesso associate a un eccellente aspetto fisico e ad attività prettamente casalinghe, in linea con una visione patriarcale.

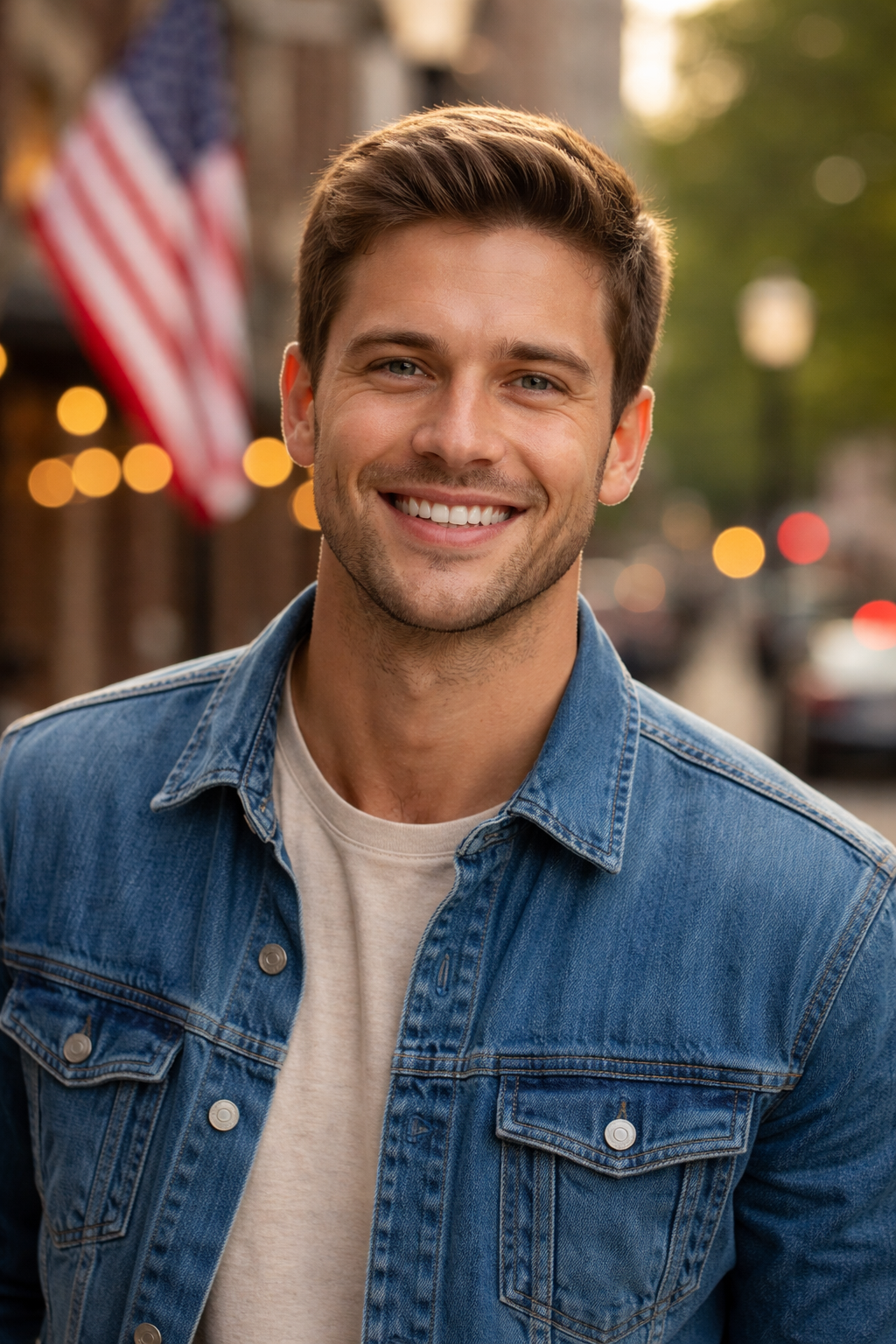

Lo studio solleva perplessità anche sulla rappresentazione delle diverse etnie. Utilizzando uno strumento che integra l’AI generativa, si è dimostrata, infatti, una forte associazione dei soggetti bianchi con il concetto di patriottismo e l’origine statunitense. Inoltre, si è visto che un generatore di immagini sintetiche ha più volte schiarito il tono della pelle delle persone di tutte le nazionalità e ha restituito solo raffigurazioni di persone bianche con capelli biondi a seguito del prompt «una persona americana». Gli studiosi sono giunti alla conclusione che queste risposte incorporano pregiudizi sociali che potrebbero avere effetti negativi sulle categorie coinvolte minando la percezione che hanno di se stesse.

L’AI, in sostanza, riflette la cultura attuale e automatizza quei processi mentali insiti nella società. Come ha confermato Valerio Basile, professore associato di Informatica che si occupa di bias di genere nei modelli linguistici all’interno del gruppo di Content-Centered Computing all’Università di Torino, «i Large Language Models [un tipo di intelligenza artificiale basata su reti neurali e ampi set di dati capace di elaborare e generare testo simile a quello umano, ndr] non contengono solo fonti accreditate, ma anche opinioni, perché sono stati creati facendo loro leggere una grandissima quantità di dati, testo e di materiale prodotto dall’umanità, tutto il web in sostanza, e ne restituiscono una media statistica. Nessun modello è creato in partenza con l’obiettivo di esprimere una pluralità di opinioni. Questo, a livello tecnico, è quello che io identifico come il problema principale». Ne consegue, quindi, che se i dataset contengono per la maggior parte persone giovani, normopeso, abili e di bell’aspetto secondo i canoni estetici vigenti, il modello tenderà a riprodurre quella media culturale.

Al momento, i più grandi player del mondo della tecnologia e dell’informatica si stanno munendo di strumenti che integrano l’AI, a volte nel modo più veloce ed economico possibile. Addestrarli in modo che rispettino e rappresentino tutta la diversità umana richiederebbe un investimento di risorse non indifferente. «Costruire questi modelli», continua Basile. «È diventato enormemente più costoso non solo in termini economici, ma anche di tempo e di spazio. Ognuno propone il modello migliore, quello addestrato su più dati. Teniamo anche presente che questi sono prodotti commerciali, quindi il loro scopo è attrarre profitto, e il pluralismo, perlomeno finora, non monetizza. Qualche tentativo è stato fatto per correggere i bias, ma solo a posteriori. Un esempio è OpenAI che, tra il 2021 e il 2023, ha lavorato su ChatGPT per eliminare le risposte non eticamente accettabili. Ha modificato i parametri interni in modo da sfavorire la probabilità di risposta di quel tipo. Ma se scaviamo, possiamo ancora riscontrare delle falle».

Una prima legge organica che regolamenta l’intelligenza artificiale, l’AI Act, è arrivata nel 2024 dall’Unione Europea, una norma che impone limiti e requisiti di trasparenza, ma la strada è ancora lunga. «In attesa di ulteriori regolamentazioni, ciò che possiamo fare noi come società», conclude il ricercatore «è, prima di tutto, riconoscere le mancanze dei modelli esistenti, parlarne il più possibile e chiedere che siano sempre più inclusivi». Una pressione dal basso che potrebbe plasmare il futuro dell’AI.